AI --大模型调用

AI –大模型调用

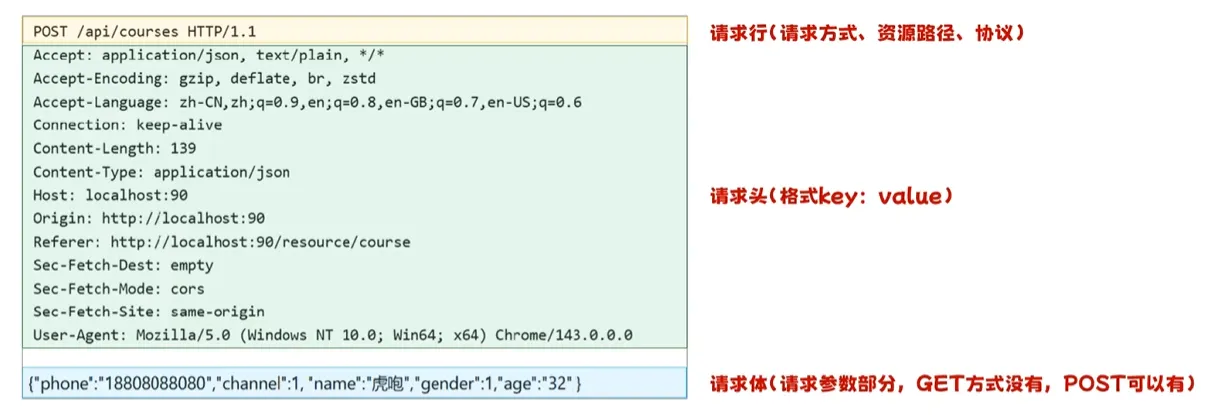

1.HTTP格式

在学习AI大模型的调用前,我们首先需要了解下HTTP的相关请求和响应格式,方便后续咱们的请求

- 请求数据格式

- 响应数据格式

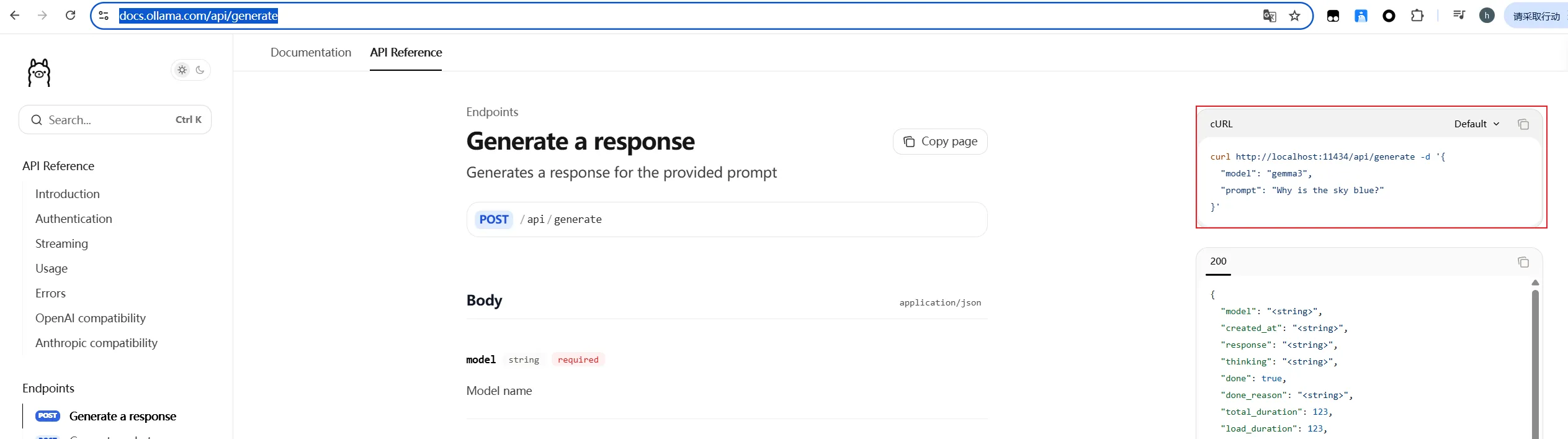

2.APIFOX接口测试–Gemini接口调用

Apifox 是一个集 API 文档、API 调试、API Mock、API 自动化测试于一体的 API 研发管理平台,我们可以通过使用这个工具进行咱们的AI API接口调用测试,这里以Gemini接口调用作为例子

各个AI官方提供的API都会附带有请求的格式要求,各个官方可能不太一样

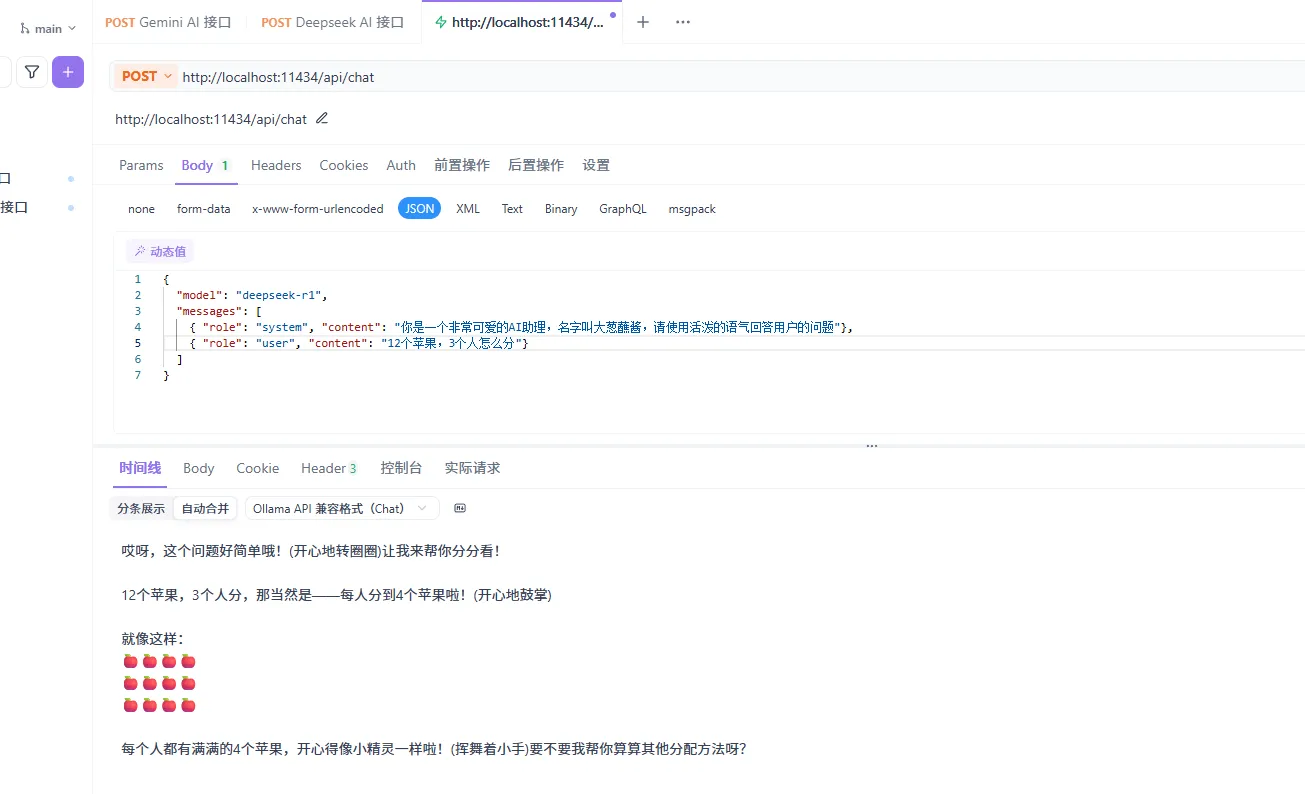

3.APIFOX接口测试–本地Deepseek接口调用

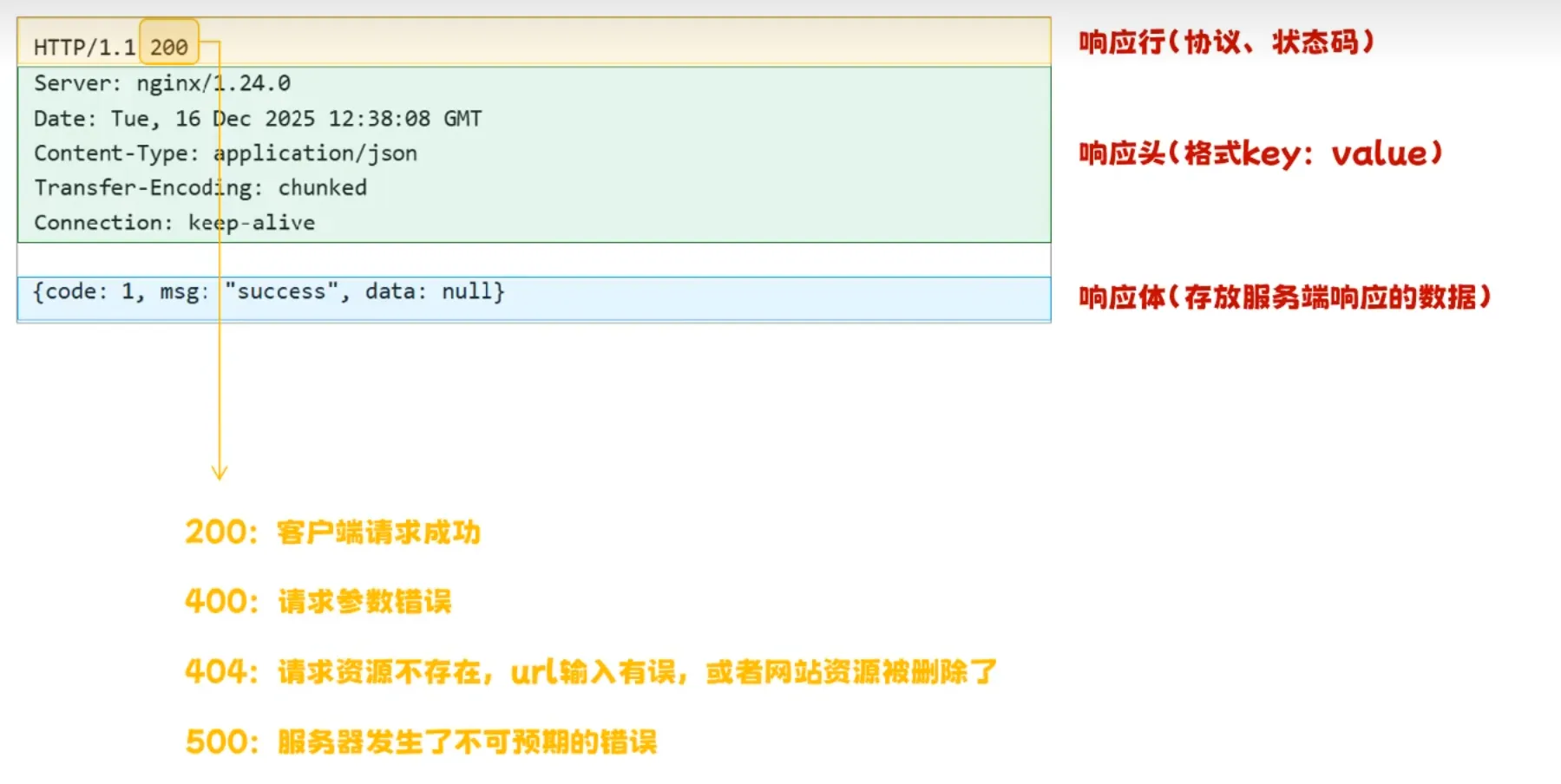

首先查看ollama的调用文档:

https://docs.ollama.com/api/generate

这里我们根据官方给的格式进行请求即可

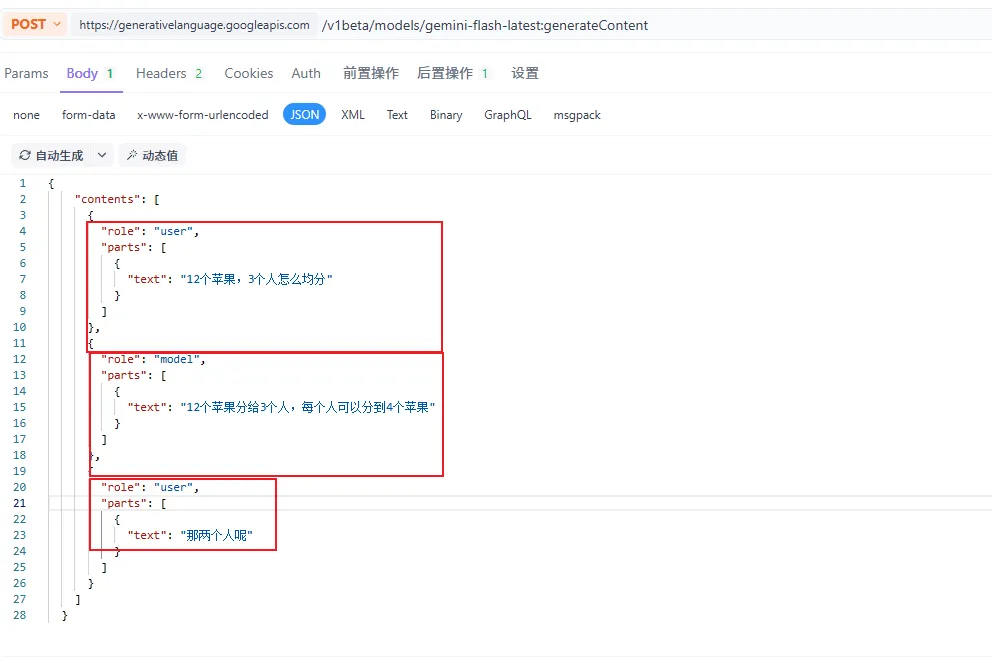

4.会话记忆方案

在与AI 大模型的交互本质是无状态的,每一次请求响应都是相互独立的,这是因为AI 大模型本身没有真正的会话记忆能力,所以在开放中需要我们自己进行会话记忆的处理,比如比较简单的滚雪球方式:

5.代码调用大模型

具体代码调用各个官方的文档也同样都会有相关的说明,这里还是以谷歌的Gemini为例子

1 | |

在此基础上,就可以衍生出通过输入进行消息存储从而达到历史会话加入的功能

1 | |

这就是一个简单的大模型交流的脚本,通过我们自己的自定义输入,给出思考和输出

6、提示词工程

提示词是引导大模型(LLM)进行内容生成的命令,目的是引导AI思考,约束其输出范围,并明确期望的结果,提示词工程则是指通过有技巧的编写提示词,使大模型生成出尽可能符合预期的内容,这一持续性的过程就称为提示词工程

AI --大模型调用

https://one-null-pointer.github.io/2026/01/04/AI --大模型调用/